ISO 13528:2005

(Main)Statistical methods for use in proficiency testing by interlaboratory comparisons

Statistical methods for use in proficiency testing by interlaboratory comparisons

ISO 13528:2005 complements ISO Guide 43 (all parts) by providing detailed descriptions of sound statistical methods for organizers to use to analyse the data obtained from proficiency testing schemes, and by giving recommendations on their use in practice by participants in such schemes and by accreditation bodies. ISO 13528:2005 can be applied to demonstrate that the measurement results obtained by laboratories do not exhibit evidence of an unacceptable level of bias. It is applicable to quantitative data but not qualitative data.

Méthodes statistiques utilisées dans les essais d'aptitude par comparaisons interlaboratoires

L'ISO 13528:2005 complète l'ISO/CEI Guide 43 (toutes les parties) en fournissant des descriptions détaillées de méthodes statistiques solides à utiliser par les organisateurs pour analyser les données obtenues à partir de systèmes d'essais d'aptitude et en donnant des recommandations sur leur utilisation par les participants à de tels systèmes et par les organismes d'accréditation. La présente Norme internationale peut être appliquée pour démontrer que les résultats de mesure obtenus par des laboratoires n'apportent pas la preuve d'un niveau de biais inacceptable. Elle s'applique à des données quantitatives et non à des données qualitatives.

General Information

- Status

- Withdrawn

- Publication Date

- 14-Sep-2005

- Withdrawal Date

- 14-Sep-2005

- Technical Committee

- ISO/TC 69/SC 6 - Measurement methods and results

- Drafting Committee

- ISO/TC 69/SC 6/WG 1 - Accuracy of measurement methods and results

- Current Stage

- 9599 - Withdrawal of International Standard

- Start Date

- 28-Jul-2015

- Completion Date

- 12-Feb-2026

Relations

- Revised

ISO 13528:2015 - Statistical methods for use in proficiency testing by interlaboratory comparison - Effective Date

- 06-Mar-2010

ISO 13528:2005 - Statistical methods for use in proficiency testing by interlaboratory comparisons

ISO 13528:2005 - Méthodes statistiques utilisées dans les essais d'aptitude par comparaisons interlaboratoires

Get Certified

Connect with accredited certification bodies for this standard

BSI Group

BSI (British Standards Institution) is the business standards company that helps organizations make excellence a habit.

Bureau Veritas

Bureau Veritas is a world leader in laboratory testing, inspection and certification services.

DNV

DNV is an independent assurance and risk management provider.

Sponsored listings

Frequently Asked Questions

ISO 13528:2005 is a standard published by the International Organization for Standardization (ISO). Its full title is "Statistical methods for use in proficiency testing by interlaboratory comparisons". This standard covers: ISO 13528:2005 complements ISO Guide 43 (all parts) by providing detailed descriptions of sound statistical methods for organizers to use to analyse the data obtained from proficiency testing schemes, and by giving recommendations on their use in practice by participants in such schemes and by accreditation bodies. ISO 13528:2005 can be applied to demonstrate that the measurement results obtained by laboratories do not exhibit evidence of an unacceptable level of bias. It is applicable to quantitative data but not qualitative data.

ISO 13528:2005 complements ISO Guide 43 (all parts) by providing detailed descriptions of sound statistical methods for organizers to use to analyse the data obtained from proficiency testing schemes, and by giving recommendations on their use in practice by participants in such schemes and by accreditation bodies. ISO 13528:2005 can be applied to demonstrate that the measurement results obtained by laboratories do not exhibit evidence of an unacceptable level of bias. It is applicable to quantitative data but not qualitative data.

ISO 13528:2005 is classified under the following ICS (International Classification for Standards) categories: 03.120.30 - Application of statistical methods. The ICS classification helps identify the subject area and facilitates finding related standards.

ISO 13528:2005 has the following relationships with other standards: It is inter standard links to ISO 13528:2015. Understanding these relationships helps ensure you are using the most current and applicable version of the standard.

ISO 13528:2005 is available in PDF format for immediate download after purchase. The document can be added to your cart and obtained through the secure checkout process. Digital delivery ensures instant access to the complete standard document.

Standards Content (Sample)

INTERNATIONAL ISO

STANDARD 13528

First edition

2005-09-01

Statistical methods for use in proficiency

testing by interlaboratory comparisons

Méthodes statistiques utilisées dans les essais d'aptitude par

comparaisons interlaboratoires

Reference number

©

ISO 2005

PDF disclaimer

This PDF file may contain embedded typefaces. In accordance with Adobe's licensing policy, this file may be printed or viewed but

shall not be edited unless the typefaces which are embedded are licensed to and installed on the computer performing the editing. In

downloading this file, parties accept therein the responsibility of not infringing Adobe's licensing policy. The ISO Central Secretariat

accepts no liability in this area.

Adobe is a trademark of Adobe Systems Incorporated.

Details of the software products used to create this PDF file can be found in the General Info relative to the file; the PDF-creation

parameters were optimized for printing. Every care has been taken to ensure that the file is suitable for use by ISO member bodies. In

the unlikely event that a problem relating to it is found, please inform the Central Secretariat at the address given below.

© ISO 2005

All rights reserved. Unless otherwise specified, no part of this publication may be reproduced or utilized in any form or by any means,

electronic or mechanical, including photocopying and microfilm, without permission in writing from either ISO at the address below or

ISO's member body in the country of the requester.

ISO copyright office

Case postale 56 • CH-1211 Geneva 20

Tel. + 41 22 749 01 11

Fax + 41 22 749 09 47

E-mail copyright@iso.org

Web www.iso.org

Published in Switzerland

ii © ISO 2005 – All rights reserved

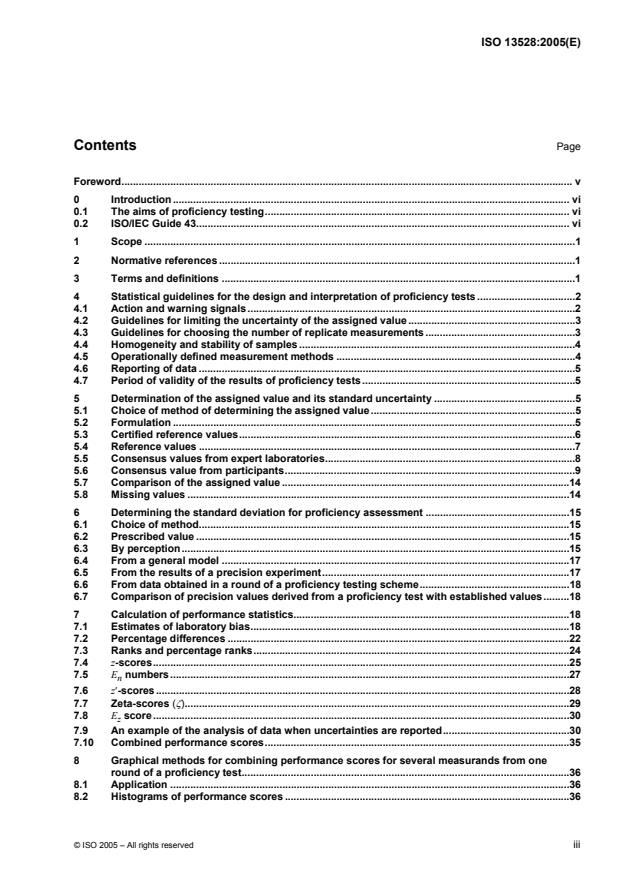

Contents Page

Foreword. v

0 Introduction. vi

0.1 The aims of proficiency testing. vi

0.2 ISO/IEC Guide 43. vi

1 Scope .1

2 Normative references .1

3 Terms and definitions .1

4 Statistical guidelines for the design and interpretation of proficiency tests .2

4.1 Action and warning signals .2

4.2 Guidelines for limiting the uncertainty of the assigned value .3

4.3 Guidelines for choosing the number of replicate measurements .3

4.4 Homogeneity and stability of samples .4

4.5 Operationally defined measurement methods .4

4.6 Reporting of data .5

4.7 Period of validity of the results of proficiency tests.5

5 Determination of the assigned value and its standard uncertainty .5

5.1 Choice of method of determining the assigned value.5

5.2 Formulation .5

5.3 Certified reference values.6

5.4 Reference values .7

5.5 Consensus values from expert laboratories.8

5.6 Consensus value from participants.9

5.7 Comparison of the assigned value .14

5.8 Missing values .14

6 Determining the standard deviation for proficiency assessment .15

6.1 Choice of method.15

6.2 Prescribed value .15

6.3 By perception.15

6.4 From a general model .17

6.5 From the results of a precision experiment.17

6.6 From data obtained in a round of a proficiency testing scheme.18

6.7 Comparison of precision values derived from a proficiency test with established values.18

7 Calculation of performance statistics.18

7.1 Estimates of laboratory bias.18

7.2 Percentage differences .22

7.3 Ranks and percentage ranks.24

7.4 z-scores.25

7.5 E numbers.27

n

7.6 z′-scores.28

7.7 Zeta-scores (ζ).29

7.8 E score.30

z

7.9 An example of the analysis of data when uncertainties are reported.30

7.10 Combined performance scores.35

8 Graphical methods for combining performance scores for several measurands from one

round of a proficiency test.36

8.1 Application .36

8.2 Histograms of performance scores .36

8.3 Bar-plots of standardized laboratory biases. 37

8.4 Bar-plots of standardized repeatability measurements. 38

8.5 Youden Plot . 38

8.6 Plots of repeatability standard deviations. 45

8.7 Split samples . 47

9 Graphical methods for combining performance scores over several rounds

of a proficiency testing scheme . 52

9.1 Applications. 52

9.2 Shewhart control chart for z-scores. 52

9.3 Cusum control chart for z-scores. 55

9.4 Plots of standardized laboratory biases against laboratory averages. 56

9.5 Dot plot. 57

Annex A (normative) Symbols . 59

Annex B (normative) Homogeneity and stability checks of samples . 60

Annex C (normative) Robust analysis. 64

Bibliography . 66

iv © ISO 2005 – All rights reserved

Foreword

ISO (the International Organization for Standardization) is a worldwide federation of national standards bodies

(ISO member bodies). The work of preparing International Standards is normally carried out through ISO

technical committees. Each member body interested in a subject for which a technical committee has been

established has the right to be represented on that committee. International organizations, governmental and

non-governmental, in liaison with ISO, also take part in the work. ISO collaborates closely with the

International Electrotechnical Commission (IEC) on all matters of electrotechnical standardization.

International Standards are drafted in accordance with the rules given in the ISO/IEC Directives, Part 2.

The main task of technical committees is to prepare International Standards. Draft International Standards

adopted by the technical committees are circulated to the member bodies for voting. Publication as an

International Standard requires approval by at least 75 % of the member bodies casting a vote.

Attention is drawn to the possibility that some of the elements of this document may be the subject of patent

rights. ISO shall not be held responsible for identifying any or all such patent rights.

ISO 13528 was prepared by Technical Committee ISO/TC 69, Applications of statistical methods,

Subcommittee SC 6, Measurement methods and results.

0 Introduction

0.1 The aims of proficiency testing

Proficiency testing by interlaboratory comparisons is used to determine the performance of individual

laboratories for specific tests or measurements, and to monitor the continuing performance of laboratories.

The Introduction to ISO/IEC Guide 43-1:1997 should be consulted for a full exposition of the purposes of

proficiency testing. In statistical language, the performance of laboratories can be described by three

properties: laboratory bias, stability and repeatability. Laboratory bias and repeatability are defined in

ISO 3534-1, ISO 3534-2 and ISO 5725-1. The stability of a laboratory’s results is measured by intermediate

precision as defined in ISO 5725-3.

Laboratory bias may be assessed by tests on reference materials, when these are available, using the

procedure described in ISO 5725-4. Otherwise, proficiency testing by interlaboratory comparisons provides a

generally available means of obtaining information about laboratory bias, and the use of data from proficiency

tests to obtain estimates of laboratory bias is an important aspect of the analysis of such data. However,

stability and repeatability will affect data obtained in proficiency tests, so that it is possible for a laboratory to

obtain data in a round of a proficiency test which indicate bias that is actually caused by poor stability or poor

repeatability. It is therefore important that these aspects of laboratory performance are assessed regularly.

Stability may be assessed by re-testing of retained samples, or by making regular measurements on a

reference material or an in-house reference material (a stock of material established by a laboratory to use as

private reference material). These techniques are described in ISO 5725-3. Stability may also be assessed by

plotting estimates of laboratory bias derived from proficiency tests in control charts. This can provide

information about laboratory performance that is not apparent from the examination of the results of individual

rounds of proficiency testing schemes, and is another important aspect of the analysis of such data.

Data suitable for assessing repeatability may be generated by tests carried out in the normal course of the

work of a laboratory, or by extra tests carried out within a laboratory specifically to assess repeatability.

Consequently, the assessment of repeatability is not necessarily an important aspect of proficiency testing,

although it is important that laboratories monitor their repeatability in some way. Repeatability may be

assessed by plotting ranges of duplicate measurements on a control chart as described in ISO 5725-6.

The flowchart (Figure 1) illustrates how the techniques described in this International Standard are to be

applied.

0.2 ISO/IEC Guide 43

ISO/IEC Guide 43-1 describes different types of proficiency testing schemes and gives guidance on the

organization and design of proficiency testing schemes. ISO/IEC Guide 43-2 gives guidance on the selection

and use of proficiency testing schemes by laboratory accreditation bodies. Those documents should be

consulted for detailed information in those areas (the information is not duplicated here). ISO/IEC Guide 43-1

contains an annex that briefly describes the statistical methods that are used in proficiency testing schemes.

This International Standard is complementary to ISO/IEC Guide 43, providing detailed guidance that is lacking

in that document on the use of statistical methods in proficiency testing. ISO 13528 is to a large extent based

[1]

on a harmonized protocol for the proficiency testing of analytical laboratories , but is intended for use with all

measurement methods.

vi © ISO 2005 – All rights reserved

Figure 1 — Flowchart showing the activities requiring the use of statistical

methods when operating a proficiency testing scheme

INTERNATIONAL STANDARD ISO 13528:2005(E)

Statistical methods for use in proficiency testing by

interlaboratory comparisons

1 Scope

This International Standard complements ISO Guide 43 (all parts) by providing detailed descriptions of sound

statistical methods for organizers to use to analyse the data obtained from proficiency testing schemes, and

by giving recommendations on their use in practice by participants in such schemes and by accreditation

bodies.

This International Standard can be applied to demonstrate that the measurement results obtained by

laboratories do not exhibit evidence of an unacceptable level of bias.

It is applicable to quantitative data but not to qualitative data.

2 Normative references

The following referenced documents are indispensable for the application of this document. For dated

references, only the edition cited applies. For undated references, the latest edition of the referenced

document (including any amendments) applies.

ISO 3534-1, Statistics — Vocabulary and symbols — Part 1: Probability and general statistical terms

1)

ISO 3534-2:— , Statistics — Vocabulary and symbols — Part 2: Applied statistics

ISO 5725-1, Accuracy (trueness and precision) of measurement methods and results — Part 1: General

principles and definitions

ISO/IEC Guide 43-1:1997, Proficiency testing by interlaboratory comparisons — Part 1: Development and

operation of proficiency testing schemes

3 Terms and definitions

For the purposes of this document, the terms and definitions given in ISO 3534-1, ISO 3534-2, ISO 5725-1

and the following apply.

3.1

interlaboratory comparison

organization, performance and evaluation of tests or measurements on the same or similar test items by two

or more laboratories in accordance with predetermined conditions

NOTE Adapted from ISO/IEC Guide 43-1.

3.2

proficiency testing

determination of laboratory testing performance by means of interlaboratory comparisons

1) To be published.

3.3

assigned value

value attributed to a particular quantity and accepted, sometimes by convention, as having an uncertainty

appropriate for a given purpose

3.4

standard deviation for proficiency assessment

measure of dispersion used in the assessment of proficiency, based on the available information

3.5

z-score

standardized measure of laboratory bias, calculated using the assigned value and the standard deviation for

proficiency assessment

3.6

coordinator

organization (or person) with responsibility for coordinating all of the activities involved in the operation

of a proficiency testing scheme

4 Statistical guidelines for the design and interpretation of proficiency tests

(see ISO/IEC Guide 43-1:1997, 5.4.2.)

4.1 Action and warning signals

4.1.1 This International Standard describes some simple numerical or graphical criteria that should be

applied to the data obtained in a proficiency test to see if they give rise to action or warning signals. Even in a

well-run laboratory, with experienced staff, anomalous results may sometimes be obtained. Also, it is possible

that a standardized measurement method, even though it has been validated by a precision experiment, may

contain faults that become apparent only after several rounds of a proficiency testing scheme. The proficiency

scheme itself may contain faults. For these reasons, the criteria given here shall not be used to condemn

laboratories, as being unfit to perform the measurement method under examination. If proficiency testing is

used to condemn laboratories, then it shall be necessary to devise appropriate criteria for that purpose.

4.1.2 The criteria given here are designed so that, when the standard deviation for proficiency assessment

is based on observed performance (using one of the methods described in 6.4 to 6.6), the criteria give action

signals when results are so exceptional as to merit investigation and corrective action.

4.1.3 The coordinator should have an understanding of the major sources of variability that can be

anticipated in proficiency test data for the measurement in question. The first step in any analysis should be to

examine the distribution of results for evidence of unanticipated sources of variability. For example, a bimodal

distribution might be evidence of a mixed population of results caused by different methods, contaminated

samples or poorly worded instructions. In this situation, the concern should be resolved before proceeding

with analysis or evaluation. Accrediting bodies shall have policies for response to unacceptable performance

in proficiency testing. Follow-up actions are determined by that policy or by the laboratory’s quality procedures.

However, there are generally recommended actions when a laboratory produces an unacceptable result in a

proficiency test. Guidance for actions by laboratories in response to unsuccessful performance on a

proficiency test is given in 4.1.4.

4.1.4 In schemes where the standard deviation for proficiency assessment is based on observed

performance, when a result gives an action signal, the laboratory shall decide what investigations and

corrective actions are appropriate, in consultation with the coordinator or an accreditation body if necessary.

Unless there is a valid reason not to do so, the laboratory shall examine its procedures and identify one or

more corrective actions that, according to staff in the laboratory, are likely to prevent the recurrence of such

results. The laboratory may ask the coordinator for advice on possible causes of its problem, or may ask the

coordinator to consult other experts. The laboratory shall take part in further rounds of the proficiency testing

scheme to assess the effectiveness of the corrective actions. Appropriate corrective actions may be one of the

following:

2 © ISO 2005 – All rights reserved

a) checking that staff understand and follow the measurement procedure;

b) checking that all details of the measurement procedure are correct;

c) checking the calibration of equipment and the composition of reagents;

d) replacing suspect equipment or reagents;

e) comparative tests of staff, equipment and/or reagents with another laboratory.

The use of the results of proficiency tests by laboratory accreditation bodies is described in

ISO/IEC Guide 43-2:1997, Clause 6.

4.2 Guidelines for limiting the uncertainty of the assigned value

The assigned value X has a standard uncertainty u that depends on the method that is used to derive it, and

X

also, when it is derived from tests in several laboratories, on the number of laboratories and, perhaps, on

other factors. Methods for calculating the standard uncertainty of the assigned value are given in Clause 5.

ˆ

The standard deviation for proficiency testing σ is used to assess the size of estimates of laboratory bias

found in a proficiency test. Methods for obtaining the standard deviation for proficiency testing are given in

Clause 6 and criteria that compare it with estimates of laboratory bias are given in Clause 7.

If the standard uncertainty u of the assigned value is too large in comparison with the standard deviation for

X

ˆ

proficiency testing σ, then there is a risk that some laboratories will receive action and warning signals

because of inaccuracy in the determination of the assigned value, not because of any cause within the

laboratories. For this reason, the standard uncertainty of the assigned value shall be established and shall be

reported to laboratories participating in proficiency testing schemes (see ISO/IEC Guide 43-1:1997, A.1.4

and A.1.6).

If

u u 0,3σˆ (1)

X

then the uncertainty of the assigned value is negligible and need not be included in the interpretation of the

results of the proficiency test.

If these guidelines are not met, then the coordinator shall consider the following.

a) Look for a method for determining the assigned value such that its uncertainty meets the above guideline.

b) Use the uncertainty of the assigned value in the interpretation of the results of the proficiency test (see

7.5 on E numbers or 7.6 on the z'-score).

n

c) Inform the participants in the proficiency test that the uncertainty of the assigned value is not negligible.

EXAMPLE Suppose that the assigned value X is determined as the average x of the results of tests in 11

laboratories, and that the standard deviation for proficiency testing is determined as the standard deviation s of these

same 11 results, so σˆ = s. As a first approximation, the standard uncertainty of the assigned value in this situation may be

estimated by u = s 11 = 0,3 s, so that the requirement appears to be met. However, the requirement cannot be met in

X

this situation with fewer than 11 laboratories. Further, the uncertainty of the assigned value will be larger than s 11 if

the samples suffer from non-homogeneity or instability, or if there is a factor that causes a common bias in the results of

the laboratories (e.g. if they all use the same reference standard).

4.3 Guidelines for choosing the number of replicate measurements

Repeatability variation contributes to the variation between the laboratory biases in a proficiency test. If the

repeatability variation is too large in comparison with the standard deviation for proficiency testing, then there

is a risk that repeatability variation will cause the results of the proficiency test to be erratic. In this situation, a

laboratory could have large bias in one round, but not the next, and they will have difficulty identifying the

cause.

For this reason, when it is considered desirable to limit the influence of repeatability variation, the number of

replicate measurements n made by each laboratory in a proficiency test shall be chosen so that:

σ n u 0,3σˆ (2)

r

where σ is the repeatability standard deviation that has been established in a previous interlaboratory

r

experiment.

The justification for the factor of 0,3 is that when this criterion is met, the repeatability standard deviation

contributes no more than about 10 % of the standard deviation for proficiency testing.

Further, all laboratories shall carry out the same number of replicate measurements. (The methods of analysis

given later in this International Standard assume that this requirement is met.) If the requirement inequality

of (2) is not met, then the number of replicate measurements shall be increased, or the results of the

proficiency test shall be interpreted with caution.

This approach assumes that laboratories have generally similar repeatability. Cases can arise where this is

not so. In such cases, for the methods described in this International Standard to be applied, the following

device may be used. The coordinator should fix the number of replicate measurements n, using a typical value

for the repeatability standard deviation. Then, each laboratory should check that it satisfies Inequality (2) with

its own repeatability standard deviation. If it does not, then it should modify its measurement procedure so that

it obtains a test result as the average of some number of determinations chosen so that Inequality (2) is

satisfied.

4.4 Homogeneity and stability of samples (see ISO/IEC Guide 43-1:1997, 5.6.2 and 5.6.3)

Methods are given in Annex B for checking that the samples to be used in a proficiency test are adequately

homogeneous and stable.

When a method of sample preparation is used such that the homogeneity criterion in Annex B is not met, then

replicate samples shall be tested by the participants, or the standard deviation for proficiency testing shall

include an allowance for the heterogeneity of the samples, as described in Annex B.

4.5 Operationally defined measurement methods

With an operationally defined measurement method, the measurement result is defined by the measurement

procedure. For example, the size distribution of a particulate material may be determined using either square-

holed or round-holed sieves. There may be no good reason why one type of sieve should be preferred, but

unless the type of sieve is specified, laboratories that use different types of sieves may obtain differing results.

If a participant uses a different method from that used to establish the assigned value, then their results may

show a bias when no fault in execution is present.

If participants are free to choose between operationally defined methods, no valid consensus may be evident

amongst them. Two recourses are available to overcome this problem:

a) when a standardized method is in routine use by the participants, it is used to establish the assigned

value, and participants are instructed to use it in the proficiency test;

b) a separate value of the assigned value is produced for each method used.

A similar situation arises when the measurand is specified, but not the procedure, and the same choice has to

be made.

4 © ISO 2005 – All rights reserved

4.6 Reporting of data (see ISO/IEC Guide 43-1:1997, 6.2.3)

For the purposes of the calculations required in proficiency testing, it is recommended that individual

measurement results should not be rounded by more than σ / 2 .

r

Participants shall be asked to report the actual values of their measurement results. Measurement results

shall not be truncated (i.e. results shall not be reported in the form “<0,1” or “less than the detection limit”).

Likewise, when a negative result is observed, the actual negative value shall be reported (i.e. results shall not

be reported as zero even when logically the measurement result cannot be negative). Participants shall be

informed that if they report truncated results on a sample, or zeros when results are negative, then all the data

for that sample will be excluded from the analysis. If necessary, the form used to report results may contain a

box to allow a participant to indicate that a result is below the detection limit.

4.7 Period of validity of the results of proficiency tests

The period of validity of the result obtained by a laboratory in a single round of a proficiency testing scheme is

limited to the time that the laboratory performed the test. Thus, if a laboratory achieves a satisfactory result in

a single round, the result shall not be used to support a claim that the laboratory obtained reliable data on any

other occasion.

A laboratory that operates a quality system and achieves a history of satisfactory results in many rounds of a

proficiency testing scheme shall be entitled to use the results as evidence that it is able to obtain consistently

reliable data.

5 Determination of the assigned value and its standard uncertainty

5.1 Choice of method of determining the assigned value

Five ways of determining the assigned value X are described in 5.2 to 5.6. The choice between these methods

shall be the responsibility of the coordinator following consultation with technical experts as described in

ISO/IEC Guide 43-1. The methods described in 5.5 and 5.6 are unlikely to be applicable when the number of

laboratories participating in the scheme is small. The methods of calculating the standard uncertainty, u , of

X

the assigned value given in this clause will usually be adequate for the applications for which they are used in

this International Standard. Alternative methods may be used provided that they have a sound statistical basis

and that the method used is described in the documented plan for the scheme.

The determination of the assigned value shall be the responsibility of the coordinator. The assigned value

shall not be disclosed to the participants until they have reported their results to the coordinator. The

coordinator shall prepare a report giving details of how the assigned value was obtained, the identities of

laboratories involved in its determination, and statements of the traceability and measurement uncertainty of

the assigned value.

The Guide to the expression of uncertainty in measurement gives guidance on the evaluation of measurement

uncertainties.

This International Standard recommends the use of robust statistical methods when it is considered that they

are the most appropriate methods to use (for example, as in 5.5 and 5.6). Alternatively, procedures that

involve the detection and removal of outliers may be used provided that they have a sound statistical basis

and the method that is used is reported. Guidance on the use of tests for outliers is given in ISO 5725-2.

5.2 Formulation [see ISO/IEC Guide 43-1:1997, A.1.1, item a)]

5.2.1 General

The test material may be prepared by mixing constituents in specified proportions, or by adding a specified

proportion of a constituent to a base material. In this case, the assigned value X is derived by calculation from

the masses used.

The approach is especially valuable when individual samples may be prepared in this way, and it is the

proportion of the constituents or of the addition that is to be determined: there is then no need to prepare a

bulk quantity and ensure that it is homogeneous. However, when formulation gives samples in which the

addition is more loosely bonded than in typical materials, or in a different form, it may be preferable to use

another approach.

5.2.2 Standard uncertainty u of the assigned value

X

When the assigned value is calculated from the formulation of the test material, the standard uncertainty is

estimated by combination of uncertainties using the approach described in the Guide to the expression of

uncertainty in measurement. For example, in chemical analyses the uncertainties will usually be those

associated with gravimetric and volumetric measurements.

The limitation of this method (in chemical analysis) is that care is needed to ensure that:

a) the base material is effectively free from the added constituent, or that the proportion of the added

constituent in the base material is accurately known;

b) the constituents are mixed together homogeneously (where this is required);

c) all sources of error are identified (e.g. it is not always realized that glass absorbs mercury compounds, so

that the concentration of an aqueous solution of a mercury compound can be altered by its container);

d) there is no interaction between the constituents and the matrix.

5.2.3 Example: Determination of the cement content of hardened concrete

In this case, concrete specimens may be prepared by weighing out quantities of the constituents (cement,

aggregates and water) and mixing them together to form each concrete sample. The approach is satisfactory

because the accuracy with the specimens can be prepared is far superior to that of the analytical method used

to determine the cement content.

5.3 Certified reference values [see ISO/IEC Guide 43-1:1997, A.1.1 item b)]

5.3.1 General

When the material used in a proficiency test is a certified reference material (CRM), its certified reference

value is used as the assigned value X.

5.3.2 Standard uncertainty u of the assigned value

X

When a certified reference material is used as the test material, the standard uncertainty of the assigned value

is derived from the information on uncertainty provided on the certificate.

The limitation of this approach is that it can be expensive to provide every participant in a proficiency test with

a sample of a certified reference material.

5.3.3 Example: Los Angeles value of aggregates

The “Los Angeles value” is a measure of the mechanical strength of aggregates that are used for road

construction, and results of the test are measured in “LA units”. In an exercise to certify a reference material, a

large number of samples of a particular aggregate were prepared, and some of these samples were used in

an interlaboratory experiment involving 28 laboratories, allowing an assigned value of X = 21,62 LA units

CRM

to be established with a standard uncertainty of u = 0,26 LA units. The remaining samples of this

X;CRM

aggregate could be used in proficiency tests.

6 © ISO 2005 – All rights reserved

5.4 Reference values [see ISO/IEC Guide 43-1:1997, A.1.1 item c)]

5.4.1 General

In this approach, samples of the test material that is to be the reference material (RM) are prepared first,

ready for distribution to the participants. A number of the samples are then selected at random and tested

along with certified reference materials, in one laboratory, using a suitable measurement method, and under

repeatability conditions (as defined in ISO 3534-2). The assigned value X of the test material is then

RM

derived from a calibration against the certified reference values of the CRMs.

5.4.2 Standard uncertainty u of the assigned value

X

When the assigned value of a test material is derived from the results of a series of tests on that material and

on CRM, the standard uncertainty of the assigned value is derived from the test results, and the uncertainties

of the certified reference values of the CRM. If the test material and the CRM are not similar (in matrix,

composition and level of results), then the uncertainty arising from this is also to be included.

This method allows the assigned value to be established in a manner that is traceable to the certified values of

the CRMs, with a standard uncertainty that can be calculated, and avoids the cost of distributing the CRM to

all the participants. These are good reasons for preferring it to other methods. However, the method assumes

that there are no interactions between the materials used and the test conditions.

The example in 5.4.3 illustrates how the required uncertainty may be calculated in the simple case when the

assigned value of a test material is established by direct comparison with a single CRM.

5.4.3 Example: Los Angeles value of aggregates

The CRM described in the example in 5.3 may be used to determine the assigned value for an RM which is

another, similar, aggregate. This determination requires a series of tests to be carried out, in one laboratory,

on samples of the two aggregates, using the same measurement method, and under repeatability conditions.

Let

X is the assigned value for the CRM

CRM

X is the assigned value for the RM

RM

D is the difference (RM − CRM) between the average results for the RM and the CRM

i

th

on the i samples

D is the average of the differences D

i

Then

XX=+D (3)

RM CRM

The standard uncertainty of the assigned value of the RM may be calculated as:

uu=+u (4)

X;RM XD;CRM

Table 1 gives an example of data that might be obtained in such a series of tests, and shows how the

standard uncertainty u of the difference is calculated.

D

With these results,

X =+21,62 1,73= 23,35 LA units (5)

RM

and

u =+0,26 0,24= 0,35 LA units (6)

X ;RM

where 0,26 is the standard uncertainty of the assigned value of the CRM (given in the example in 5.3), and

0,24 is the standard uncertainty of D .

Table 1 — Calculation of the average difference between a CRM and a RM,

and of the standard uncertainty of this difference

RM CRM Difference in average values

Sample

Test 1 Test 2 Test 1 Test 2 RM − CRM

LA units LA units LA units LA units LA units

1 20,5 20,5 19,0 18,0 2,00

2 21,1 20,7 19,8 19,9 1,05

3 21,5 21,5 21,0 21,0 0,50

4 22,3 21,7 21,0 20,8 1,10

5 22,7 22,3 20,5 21,0 1,75

6 23,6 22,4 20,3 20,3 2,70

7 20,9 21,2 21,5 21,8 −0,60

8 21,4 21,5 21,9 21,7 −0,35

9 23,5 23,5 21,0 21,0 2,50

10 22,3 22,9 22,0 21,3 0,95

11 23,5 24,1 20,8 20,6 3,10

12 22,5 23,5 21,0 22,0 1,50

13 22,5 23,5 21,0 21,0 2,00

14 23,4 22,7 22,0 22,0 1,05

15 24,0 24,2 22,1 21,5 2,30

16 24,5 24,4 22,3 22,5 2,05

17 24,8 24,7 22,0 21,9 2,80

18 24,7 25,1 21,9 21,9 3,00

19 24,9 24,4 22,4 22,6 2,15

20 27,2 27,0 24,5 23,7 3,00

1,73

Average difference, D

Standard deviation 1,07

0,24

Standard uncertainty of D (standard deviation / 20 )

NOTE The data are measurements of the mechanical strength of aggregate, obtained from the Los Angeles (LA) test.

5.5 Consensus values from expert laboratories [see ISO/IEC Guide 43-1:1997, A.1.1 item d)]

5.5.1 General

As with the reference values approach (5.4), samples of the test material are prepared first, ready for

distribution to the participants. Some of these samples are then selected at random and analysed by a group

of expert laboratories. Alternatively, the group of expert laboratories may be participants in a round of a

proficiency testing scheme, when the assigned value and its uncertainty will be derived after the round is

completed. The assigned value X is calculated as the robust average of the results reported by the group of

expert laboratories, calculated using Algorithm A in Annex C.

8 © ISO 2005 – All rights reserved

Other calculation methods may be used in place of Algorithm A, provided that they have a sound statistical

basis and the report describes the method that is used.

5.5.2 Standard uncertainty u of the assigned value

X

When each of p expert laboratories reports a measurement x on the test material together with an estimate u

i i

of the standard uncertainty of the measurement, and the assigned value X is calculated as a robust average

using Algorithm A, the standard uncertainty of the assigned value X is estimated as:

p

1, 25

uu=× (7)

X i

∑

p

i=1

When the expert laboratories do not report standard uncertainties, or when the uncertainties are not validated

independently (e.g. by a laboratory accreditation body), the standard uncertainty of the assigned value shall

be estimated as described in 5.6.

NOTE The factor 1,25 represents the ratio of the standard deviation of the median to the standard deviation of the

arithmetic mean, for large samples (p > 10) from a normal distribution. For normally distributed data, the standard

deviation of a robust average calculated using the algorithm in Annex C is not known, but will fall somewhere between the

standard deviation of the arithmetic mean and the standard deviation of the median, so the formula gives a conservative

estimate of the standard uncertainty u . For p < 10, the appropriate factor is less than 1,25, so the formula is then doubly

X

conservative.

The limitations of this approach are that there may be an unknown bias in the results of the group of expert

laboratories, and the claimed uncertainties may not be reliable.

5.5.3 Example: Petrographic analysis of aggregates

This approach may be used when samples of aggregates are to be distributed, and the participants are to

determine the petrographic composition of the samples. Classification of aggregates requires skill and

experience, and there are no reference materials available, so in this case the consensus of a small group of

experts may well be the best way to establish assigned values.

5.6 Consensus value from participants [see ISO/IEC Guide 43-1:1997, A.1.1 item e)]

5.6.1 General

With this approach, the assigned value X for the test material used in a round of a proficiency testing scheme

is the robust average of the results reported by all the participants in the round, calculated using Algorithm A

in Annex C.

Other calculation methods may be used in place of Algorithm A, provided that they have a sound statistical

basis and the report describes the method that is used. For example, the calculation in C.1 may be stopped at

Equation (53) when the median is obtained, and the median absolute deviation may be used in place of C.2.

This approach may b

...

NORME ISO

INTERNATIONALE 13528

Première édition

2005-09-01

Méthodes statistiques utilisées dans les

essais d'aptitude par comparaisons

interlaboratoires

Statistical methods for use in proficiency testing by interlaboratory

comparisons

Numéro de référence

©

ISO 2005

PDF – Exonération de responsabilité

Le présent fichier PDF peut contenir des polices de caractères intégrées. Conformément aux conditions de licence d'Adobe, ce fichier

peut être imprimé ou visualisé, mais ne doit pas être modifié à moins que l'ordinateur employé à cet effet ne bénéficie d'une licence

autorisant l'utilisation de ces polices et que celles-ci y soient installées. Lors du téléchargement de ce fichier, les parties concernées

acceptent de fait la responsabilité de ne pas enfreindre les conditions de licence d'Adobe. Le Secrétariat central de l'ISO décline toute

responsabilité en la matière.

Adobe est une marque déposée d'Adobe Systems Incorporated.

Les détails relatifs aux produits logiciels utilisés pour la création du présent fichier PDF sont disponibles dans la rubrique General Info

du fichier; les paramètres de création PDF ont été optimisés pour l'impression. Toutes les mesures ont été prises pour garantir

l'exploitation de ce fichier par les comités membres de l'ISO. Dans le cas peu probable où surviendrait un problème d'utilisation,

veuillez en informer le Secrétariat central à l'adresse donnée ci-dessous.

© ISO 2005

Droits de reproduction réservés. Sauf prescription différente, aucune partie de cette publication ne peut être reproduite ni utilisée sous

quelque forme que ce soit et par aucun procédé, électronique ou mécanique, y compris la photocopie et les microfilms, sans l'accord écrit

de l'ISO à l'adresse ci-après ou du comité membre de l'ISO dans le pays du demandeur.

ISO copyright office

Case postale 56 • CH-1211 Geneva 20

Tel. + 41 22 749 01 11

Fax. + 41 22 749 09 47

E-mail copyright@iso.org

Web www.iso.org

Publié en Suisse

ii © ISO 2005 – Tous droits réservés

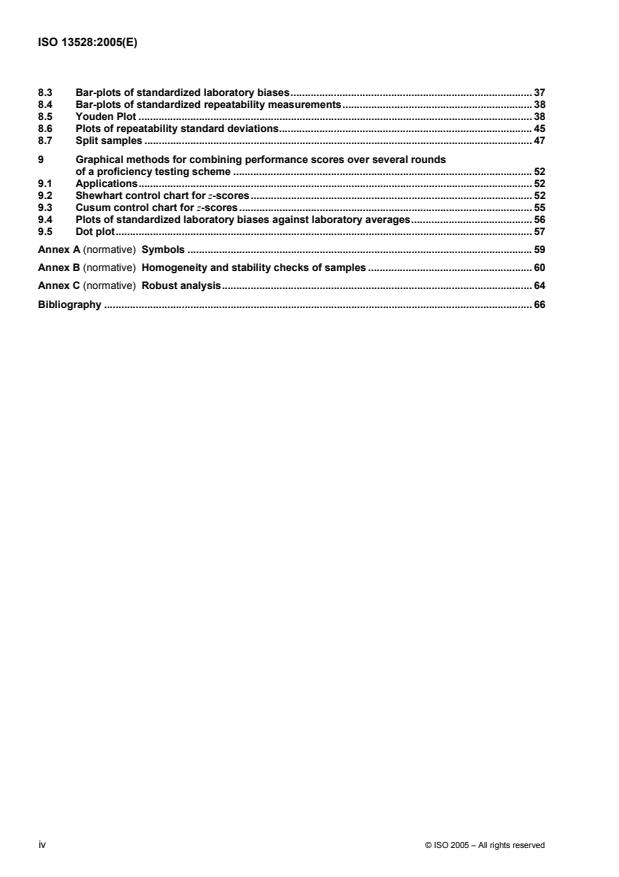

Sommaire Page

Avant-propos. v

0 Introduction . vi

0.1 Objectifs des essais d'aptitude . vi

0.2 ISO/CEI Guide 43. vi

1 Domaine d'application. 1

2 Références normatives . 1

3 Termes et définitions. 1

4 Lignes directrices pour la conception et l'interprétation statistiques d'essais d'aptitude . 2

4.1 Signaux d'action et d'avertissement. 2

4.2 Lignes directrices pour limiter l'incertitude de la valeur assignée . 3

4.3 Lignes directrices pour choisir le nombre de mesurages à répéter . 4

4.4 Homogénéité et stabilité des échantillons . 4

4.5 Définition des méthodes opérationnelles de mesure définies . 4

4.6 Présentation des données . 5

4.7 Période de validité des résultats d'essais d'aptitude . 5

5 Détermination de la valeur assignée et de son incertitude type . 5

5.1 Choix de la méthode de détermination de la valeur assignée . 5

5.2 Formulation . 6

5.3 Valeurs de référence certifiées . 6

5.4 Valeurs de référence. 7

5.5 Valeurs consensuelles provenant de laboratoires experts . 9

5.6 Valeurs consensuelles des laboratoires participants . 9

5.7 Comparaison de la valeur assignée. 14

5.8 Valeurs manquantes. 14

6 Détermination de l'écart-type pour l'évaluation de l'aptitude . 15

6.1 Choix de la méthode. 15

6.2 Méthode par prescription. 15

6.3 Méthode par perception . 15

6.4 Détermination à partir d'un modèle général . 17

6.5 Détermination à partir des résultats d'une expérience de fidélité. 17

6.6 Détermination à partir de données obtenues dans un cycle d'un programme d'essais

d'aptitude. 18

6.7 Comparaison entre les valeurs de fidélité déduites d'un essai d'aptitude et les valeurs

établies. 18

7 Calcul des statistiques de performances.19

7.1 Estimations du biais de laboratoire. 19

7.2 Différences en pourcentage . 22

7.3 Rangs et rangs en pourcentage. 24

7.4 Scores z. 25

7.5 Nombres E . 27

n

7.6 Scores z′ . 28

7.7 Scores zéta (ζ). 29

7.8 Score E . 30

z

7.9 Exemple de l'analyse de données quand des incertitudes sont fournies . 30

7.10 Scores composés de performance . 35

8 Méthodes graphiques de combinaison des scores de performance pour plusieurs

mesurandes à partir d'un seul cycle d'un essai d'aptitude. 36

8.1 Application. 36

8.2 Histogrammes de scores de performance . 36

8.3 Diagrammes en bâtons des biais de laboratoire normalisés . 37

8.4 Diagrammes en bâtons de mesures de répétabilité normalisées. 38

8.5 Graphique de Youden. 38

8.6 Graphiques d'écarts-types de répétabilité .45

8.7 Échantillons partagés. 47

9 Méthodes graphiques de combinaison des scores de performance sur plusieurs cycles

d'un programme d'essais d'aptitude. 52

9.1 Applications. 52

9.2 Carte de contrôle de Shewhart pour les scores z. 52

9.3 Carte de contrôle CUSUM (somme cumulée) pour les scores z . 55

9.4 Représentations graphiques du biais de laboratoire normalisé par rapport à la moyenne

des laboratoires . 56

9.5 Diagramme en points. 57

Annexe A (normative) Symboles . 59

Annexe B (normative) Vérification de l'homogénéité et de la stabilité des échantillons . 60

Annexe C (normative) Analyse robuste . 64

Bibliographie . 66

iv © ISO 2005 – Tous droits réservés

Avant-propos

L'ISO (Organisation internationale de normalisation) est une fédération mondiale d'organismes nationaux de

normalisation (comités membres de l'ISO). L'élaboration des Normes internationales est en général confiée

aux comités techniques de l'ISO. Chaque comité membre intéressé par une étude a le droit de faire partie du

comité technique créé à cet effet. Les organisations internationales, gouvernementales et non

gouvernementales, en liaison avec l'ISO participent également aux travaux. L'ISO collabore étroitement avec

la Commission électrotechnique internationale (CEI) en ce qui concerne la normalisation électrotechnique.

Les Normes internationales sont rédigées conformément aux règles données dans les Directives ISO/CEI,

Partie 2.

La tâche principale des comités techniques est d'élaborer les Normes internationales. Les projets de Normes

internationales adoptés par les comités techniques sont soumis aux comités membres pour vote. Leur

publication comme Normes internationales requiert l'approbation de 75 % au moins des comités membres

votants.

L'attention est appelée sur le fait que certains des éléments du présent document peuvent faire l'objet de

droits de propriété intellectuelle ou de droits analogues. L'ISO ne saurait être tenue pour responsable de ne

pas avoir identifié de tels droits de propriété et averti de leur existence.

L'ISO 13528 a été élaborée par le comité technique ISO/TC 69, Applications des méthodes statistiques,

sous-comité SC 6, Méthodes et résultats de mesure.

0 Introduction

0.1 Objectifs des essais d'aptitude

Les essais d'aptitude par comparaisons interlaboratoires sont utilisés pour déterminer les performances de

laboratoires individuels, relatives à des essais ou à des mesures spécifiques et pour surveiller la continuité

des performances des laboratoires. Il convient de consulter l'introduction de l'ISO/CEI Guide 43-1:1997 qui

expose intégralement les objectifs des essais d'aptitude. Dans le langage statistique, les performances des

laboratoires peuvent être décrites par trois propriétés: le biais de laboratoire, la stabilité et la répétabilité. Le

biais de laboratoire et la répétabilité sont définis dans l'ISO 3534-1, dans l'ISO 3534-2 et dans l'ISO 5725-1.

La stabilité d'un résultat de laboratoire est mesurée par la fidélité intermédiaire telle que spécifiée dans

l'ISO 5725-3.

Le biais de laboratoire peut être évalué par des essais réalisés sur des matériaux de référence, lorsque

ceux-ci sont disponibles, en utilisant la procédure décrite dans l'ISO 5725-4. Sinon, les essais d'aptitude par

comparaisons interlaboratoires fournissent un moyen généralement disponible d'obtenir des informations sur

le biais de laboratoire, et l'utilisation de données provenant d'essais d'aptitude, pour obtenir des estimations

du biais de laboratoire est un aspect important de l'analyse de ces données. La stabilité et la répétabilité

affecteront toutefois les données obtenues dans les essais d'aptitude, de telle sorte qu'un laboratoire pourra

obtenir des données pendant un cycle d'un essai d'aptitude indiquant un biais causé en réalité par une

stabilité ou une répétabilité insuffisante. Il est donc important que ces aspects de performances des

laboratoires soient évalués régulièrement.

La stabilité peut être évaluée en procédant à de nouveaux essais sur des échantillons retenus ou à des

mesurages réguliers sur un matériau de référence ou de référence interne (stock de matériaux établi par un

laboratoire pour les utiliser comme matériaux de référence privés). Ces techniques sont décrites dans

l'ISO 5725-3. La stabilité peut également être évaluée en traçant sur des cartes de contrôle les estimations du

biais de laboratoire déduites des essais d'aptitude. Cela peut apporter des informations sur la performance du

laboratoire qui ne découlent pas de manière évidente de l'examen des résultats des cycles individuels de

programmes d'essais d'aptitude, et il s'agit là d'un aspect important de l'analyse de telles données.

Les données appropriées à l'évaluation de la répétabilité peuvent être générées par des essais réalisés dans

le cours normal du travail d'un laboratoire ou par des essais exceptionnels réalisés à l'intérieur d'un

laboratoire et destinés spécifiquement à évaluer la répétabilité. Par conséquent, l'évaluation de la répétabilité

n'est pas nécessairement un aspect important des essais d'aptitude, même s'il est important que les

laboratoires surveillent leur répétabilité d'une certaine manière. La répétabilité peut être évaluée en traçant les

étendues de mesurages en double sur une carte de contrôle, comme décrit dans l'ISO 5725-6.

L'organigramme (Figure 1) illustre comment appliquer les techniques décrites dans la présente Norme

internationale.

0.2 ISO/CEI Guide 43

L'ISO/CEI Guide 43-1 décrit différents types de programmes d’essais d’aptitude et donne des indications sur

l'organisation et la conception de programmes d’essais d’aptitude. L'ISO/CEI Guide 43-2 donne des

indications sur la sélection et l'utilisation de programmes d’essais d’aptitude par des organismes

d'accréditation de laboratoires. Il convient de consulter les deux parties de ce Guide pour avoir des

informations détaillées sur ces questions (les informations qui y figurent ne sont pas recopiées ici).

L'ISO/CEI Guide 43-1 comprend une annexe qui décrit brièvement les méthodes statistiques utilisées dans

les programmes d’essais d’aptitude.

L'ISO 13528 complète l'ISO/CEI Guide 43, donnant des indications détaillées, qui ne figurent pas dans ce

Guide, sur l'utilisation de méthodes statistiques dans les essais d'aptitude. Dans une large mesure,

[1]

l'ISO 13528 est fondée sur un protocole harmonisé pour les essais d'aptitude de laboratoires d'analyses ,

mais elle est destinée à être utilisée avec toutes les méthodes de mesure.

vi © ISO 2005 – Tous droits réservés

Figure 1 — Organigramme représentant les activités nécessitant l'utilisation de méthodes

statistiques lors de la mise en œuvre d'un programme d'essais d'aptitude

NORME INTERNATIONALE ISO 13528:2005(F)

Méthodes statistiques utilisées dans les essais d'aptitude par

comparaisons interlaboratoires

1 Domaine d'application

La présente Norme internationale complète l'ISO/CEI Guide 43 (toutes les parties), en fournissant des

descriptions détaillées de méthodes statistiques éprouvées à utiliser par les organisateurs pour analyser les

données obtenues à partir de programmes d’essais d’aptitude et en donnant des recommandations sur leur

utilisation par les participants à de tels programmes et par les organismes d'accréditation.

La présente Norme internationale peut être appliquée pour démontrer que les résultats de mesure obtenus

par des laboratoires ne font pas apparaître un niveau de biais inacceptable.

Elle s'applique à des données quantitatives et non à des données qualitatives.

2 Références normatives

Les documents de référence suivants sont indispensables pour l'application du présent document. Pour les

références datées, seule l'édition citée s'applique. Pour les références non datées, la dernière édition du

document de référence s'applique (y compris les éventuels amendements).

ISO 3534-1, Statistiques — Vocabulaire et symboles — Partie 1: Probabilité et termes statistiques généraux

1)

ISO 3534-2:— , Statistiques — Vocabulaire et symboles — Partie 2: Statistique appliquée

ISO 5725-1, Exactitude (justesse et fidélité) des résultats et méthodes de mesure — Partie 1: Principes

généraux et définitions

ISO/CEI Guide 43-1, Essais d'aptitude des laboratoires par intercomparaison — Partie 1: Développement et

mise en œuvre de programmes d’essais d’aptitude

3 Termes et définitions

Pour les besoins du présent document, les termes et définitions donnés dans l'ISO 3534-1, l'ISO 3534-2,

l'ISO 5725-1 ainsi que les suivants s'appliquent.

3.1

comparaison interlaboratoires

organisation, réalisation et évaluation d'essais ou de mesures sur des objets soumis à l'essai ou à des essais

semblables par au moins deux laboratoires différents dans des conditions prédéterminées

NOTE Adapté de l'ISO/CEI Guide 43-1.

1) À publier.

3.2

essai d'aptitude

détermination de la performance d'un laboratoire en matière d'essais, au moyen de comparaisons

interlaboratoires

3.3

valeur assignée

valeur attribuée à une grandeur particulière et reconnue, parfois par convention, comme ayant une incertitude

appropriée à un usage donné

3.4

écart-type pour l'évaluation de l'aptitude

mesure de dispersion utilisée dans l'évaluation de l'aptitude et basée sur l' information disponible

3.5

score z

mesure normalisée du biais de laboratoire, calculée à partir de la valeur assignée et de l'écart-type pour

l'évaluation de l'aptitude

3.6

coordonnateur

organisation (ou personne) responsable de la coordination de toutes les activités intervenant dans la mise en

œuvre d'un programme d'essais d'aptitude

4 Lignes directrices pour la conception et l'interprétation statistiques d'essais

d'aptitude (voir l'ISO/CEI Guide 43-1:1997, 5.4.2)

4.1 Signaux d'action et d'avertissement

4.1.1 La présente Norme internationale décrit des critères graphiques et numériques simples qu'il convient

d'appliquer aux données obtenues dans un essai d'aptitude pour voir s'ils déclenchent des signaux d'action ou

d'avertissement. Des résultats anormaux sont parfois obtenus même dans un laboratoire bien tenu, avec du

personnel expérimenté. Il peut arriver également qu'une méthode de mesure normalisée, même si elle a été

validée par une expérience de fidélité, comporte des défauts qui n'apparaissent qu'au bout de plusieurs cycles

d'essais d'aptitude. Le programme d'essais d'aptitude en lui-même peut comporter des défauts. C'est pour

ces raisons que les critères donnés ici ne doivent pas servir à condamner les laboratoires pour incapacité à

appliquer la méthode de mesure en cours d'examen. Si les essais d'aptitude sont utilisés pour condamner les

laboratoires, alors des critères appropriés doivent être définis.

4.1.2 Les critères donnés ici sont conçus de telle sorte que lorsque l'écart-type pour l'évaluation de

l'aptitude est fondé sur la performance observée (en utilisant l'une des méthodes décrites en 6.4 à 6.6), ils

déclenchent des signaux d'action quand les résultats sont si exceptionnels qu'ils méritent une investigation et

une action corrective.

4.1.3 Il convient que le coordonnateur comprenne les sources principales de variabilité qui peuvent être

anticipées dans les données d'essais d'aptitude pour les mesurages considérés. Il convient que la première

étape de toute analyse soit d'étudier la distribution des résultats afin de mettre en évidence des sources de

variabilité non prévues. Par exemple, une distribution bimodale peut mettre en évidence un mélange de

populations de résultats causée par des méthodes différentes, des échantillons pollués ou des instructions

mal rédigées. Dans ce cas, il convient de résoudre le problème avant de procéder à l'analyse ou à l'évaluation.

Les organismes d'accréditation doivent avoir des règles pour répondre à des performances inacceptables

dans les essais d'aptitude. Les actions de suivi sont définies par ces règles ou par les procédures qualité du

laboratoire. Néanmoins, il y a généralement des actions recommandées quand un laboratoire produit un

résultat non acceptable dans un essai d'aptitude. Des recommandations d'actions pour des laboratoires

confrontés à une performance insatisfaisante dans un essai d'aptitude sont données en 4.1.4.

4.1.4 Dans les programmes où l'écart-type pour l'évaluation de l'aptitude est fondé sur une performance

observée, lorsqu'un résultat déclenche un signal d'action, le laboratoire doit décider des investigations et des

actions correctives appropriées, en consultant le coordonnateur ou un organisme d'accréditation si nécessaire.

2 © ISO 2005 – Tous droits réservés

Sauf s'il existe une raison valable de ne pas procéder ainsi, le laboratoire doit examiner ses procédures et

identifier au moins une action corrective susceptible d'éviter que de tels résultats ne se reproduisent, ceci en

accord avec le personnel du laboratoire. Le laboratoire peut demander des conseils au coordonnateur sur les

causes possibles du problème ou lui demander de consulter d'autres experts. Le laboratoire doit participer

aux cycles ultérieurs d'essais d'aptitude pour évaluer l'efficacité des actions correctives. Les actions

correctives appropriées peuvent être l'une des actions suivantes:

a) vérifier que le personnel comprend et suit la procédure de mesurage;

b) vérifier que tous les détails de la procédure de mesurage sont corrects;

c) vérifier l'étalonnage des équipements et la composition des réactifs;

d) remplacer les équipements et les réactifs suspects;

e) réaliser des essais comparatifs du personnel, des équipements et/ou des réactifs avec un autre

laboratoire.

L'utilisation des résultats des essais d'aptitude par les organismes d'accréditation de laboratoires est décrite

dans l'ISO/CEI Guide 43-2:1997, Article 6.

4.2 Lignes directrices pour limiter l'incertitude de la valeur assignée

La valeur assignée X a une incertitude type u qui dépend de la méthode utilisée pour l'obtenir et aussi,

X

lorsqu'elle est déduite d'essais réalisés dans plusieurs laboratoires, du nombre de laboratoires et, peut-être,

d'autres facteurs. Les méthodes de calcul de l'incertitude type de la valeur assignée sont spécifiées dans

l'Article 5.

ˆ

L'écart-type pour les essais d'aptitude σ est utilisé pour évaluer l'importance des estimations du biais de

laboratoire trouvé lors d'un essai d'aptitude. Les méthodes d'obtention de l'écart-type pour les essais

d'aptitude sont spécifiées dans l'Article 6 et les critères qui le comparent aux estimations du biais de

laboratoire sont spécifiés dans l'Article 7.

Si l'incertitude type u de la valeur assignée est trop grande par rapport à l'écart-type pour les essais

X

d'aptitude σˆ, certains laboratoires risquent de recevoir des signaux d'action et d'avertissement en raison

d'une inexactitude dans la détermination de la valeur assignée et non pas pour une raison quelconque liée

aux laboratoires mêmes. C'est pourquoi, l'incertitude type de la valeur assignée doit être fixée et indiquée aux

laboratoires participant aux programmes d’essais d’aptitude (voir l'ISO/CEI Guide 43-1:1997, A.1.4 et A.1.6).

Si

u u 0,3σˆ (1)

X

alors l'incertitude de la valeur assignée est négligeable et ne nécessite pas d'être incluse dans l'interprétation

des résultats de l'essai d'aptitude.

Si ces lignes directrices ne sont pas satisfaites, le coordonnateur doit envisager de procéder comme suit.

a) Rechercher une méthode pour déterminer la valeur assignée de telle sorte que son incertitude réponde à

la ligne directrice énoncée ci-dessus.

b) Utiliser l'incertitude de la valeur assignée dans l'interprétation des résultats de l'essai d'aptitude (voir 7.5

sur les nombres E ou 7.6 sur les scores z′ ).

n

c) Informer les participants à l'essai d'aptitude que l'incertitude de la valeur assignée n'est pas négligeable.

EXEMPLE Supposons que la valeur assignée X est déterminée comme étant la moyenne x des résultats d'essais

réalisés dans 11 laboratoires et que l'écart-type pour les essais d'aptitude est déterminé comme étant l'écart-type s de ces

mêmes 11 résultats, de sorte qu'on a σˆ = s . Comme première approximation, l'incertitude type de la valeur assignée

dans ce cas peut être estimée à u = s 11 = 0,3s, ainsi l'exigence semble satisfaite. Cependant, l'exigence ne peut pas

X

être satisfaite dans cette situation s'il y a moins de 11 laboratoires. De plus, l'incertitude de la valeur assignée sera

supérieure par s 11 si les échantillons ne sont pas homogènes ou s'ils sont instables ou s'il existe un facteur

provoquant un biais commun dans les résultats des laboratoires (par exemple, si tous les laboratoires utilisent le même

étalon de référence).

4.3 Lignes directrices pour choisir le nombre de mesurages à répéter

La variation de répétabilité entraîne une variation entre les biais de laboratoire dans un essai d'aptitude. Si la

variation de la répétabilité est trop grande par rapport à l'écart-type pour les essais d'aptitude, les résultats de

l'essai d'aptitude risquent d'être irréguliers. Dans cette situation, un laboratoire peut avoir un biais important

dans un cycle d'essais, mais pas dans le suivant, et il aura des difficultés à en identifier la cause.

Par conséquent, lorsqu'il s'avère souhaitable de limiter l'influence de la variation de répétabilité, le nombre n

de mesurages répétés, effectués par chaque laboratoire lors d'un essai d'aptitude, doit être choisi de façon

que:

σ n u 0,3σˆ (2)

r

où σ est l'écart-type de répétabilité établi lors d'une expérience interlaboratoires précédente.

r

Le facteur 0,3 est justifié par le fait que quand ce critère est satisfait, l'écart-type de répétabilité ne contribue

pas à plus de 10 % de l'écart-type pour l'essai d'aptitude.

En outre, tous les laboratoires doivent réaliser le même nombre de mesurages répétés. (Les méthodes

d'analyse données plus loin dans la présente Norme internationale supposent que cette exigence est

satisfaite.) Si l'Inégalité (2) n'est pas satisfaite, le nombre de mesurages à répéter doit être augmenté ou bien

les résultats de l'essai d'aptitude doivent être interprétés avec prudence.

Cette approche suppose que les laboratoires présentent généralement une répétabilité semblable. Mais ce

n'est pas toujours le cas. On peut alors procéder de la façon suivante pour que les méthodes décrites dans la

présente Norme internationale puissent s'appliquer. Il convient que le coordonnateur fixe le nombre n de

mesurages répétés en utilisant une valeur type pour l'écart-type de répétabilité. Ensuite, il convient que

chaque laboratoire vérifie qu'il répond à l'Inégalité (2) avec son propre écart-type de répétabilité. Dans le cas

contraire, il convient alors qu'il modifie sa procédure de mesurage de manière à obtenir un résultat d'essai

égal à la moyenne d'un certain nombre de déterminations, nombre choisi pour que l'Inégalité (2) soit satisfaite.

4.4 Homogénéité et stabilité des échantillons (voir l'ISO/CEI Guide 43-1:1997, 5.6.2 et 5.6.3)

Des méthodes destinées à vérifier que les échantillons à utiliser dans un essai d'aptitude sont suffisamment

homogènes et stables sont indiquées à l'Annexe B.

En cas d'utilisation d'une méthode de préparation d'échantillons ne répondant pas au critère d'homogénéité

défini à l'Annexe B, des échantillons répétés doivent être essayés par les participants ou bien l'écart-type pour

les essais d'aptitude doit tenir compte de l'hétérogénéité des échantillons, telle que spécifiée à l'Annexe B.

4.5 Définition des méthodes opérationnelles de mesure définies

Avec une méthode opérationnelle de mesure définie, le résultat de mesure est déterminé par la procédure de

mesure. Par exemple, la granulométrie d'un matériau particulier peut être déterminée à l'aide de tamis à

maille carrée ou de tamis à maille ronde. Il n'y a pas forcément de bonnes raisons de préférer l'un ou l'autre

type de tamis, mais il se peut que les laboratoires utilisant différents types de tamis obtiennent des résultats

différents, ce qui ne peut avoir lieu si le type de tamis est spécifié. Si un participant utilise une méthode

différente de celle utilisée pour déterminer la valeur assignée, les résultats peuvent révéler un biais alors qu'il

n'y a aucune erreur d'exécution.

Si les participants sont libres de choisir parmi des méthodes opérationnelles de mesure définies, il se peut

qu'ils n'aboutissent pas à un consensus valable entre eux. Deux solutions se présentent pour résoudre ce

problème:

4 © ISO 2005 – Tous droits réservés

a) lorsqu'une méthode normalisée est d'emploi courant par les participants, elle permet de déterminer la

valeur assignée et les participants sont priés de l'utiliser pour les essais d'aptitude;

b) une valeur spécifique de la valeur assignée est fournie pour chacune des méthodes utilisées.

Une situation semblable apparaît lorsque le mesurande est spécifié, mais pas la procédure, un choix de

même nature est alors à faire.

4.6 Présentation des données (voir l'ISO/CEI Guide 43-1:1997, 6.2.3)

Pour les calculs nécessaires à effectuer dans les essais d'aptitude, il est recommandé que les résultats de

mesure individuels ne soient pas arrondis de plus de σ 2 .

r

Il doit être demandé aux participants de consigner les valeurs réelles de leurs résultats de mesure. Les

résultats de mesure ne doivent pas être tronqués (c'est-à-dire que les résultats ne doivent pas être présentés

sous la forme «< 0,1» ou «inférieur à la limite de détection»). De même, lorsqu'un résultat négatif est observé,

la valeur négative réelle doit être donnée (c'est-à-dire que les résultats ne doivent pas être notés comme étant

égaux à zéro, même si, logiquement, le résultat de mesure ne peut pas être négatif). Les participants doivent

être informés du fait que, s'ils fournissent des résultats tronqués sur un échantillon ou des zéros lorsque les

résultats sont négatifs, l'ensemble des données concernant cet échantillon seront exclues de l'analyse. Si

nécessaire, le formulaire utilisé pour consigner les résultats peut contenir un encadré pour permettre à un

participant d'indiquer qu'un résultat est au-dessous de la limite de détection.

4.7 Période de validité des résultats d'essais d'aptitude

La période de validité du résultat obtenu par un laboratoire sur un seul cycle d'un programme d'essais

d'aptitude se limite à la période de ce cycle d'essais par le laboratoire. Par conséquent, si un laboratoire

obtient un résultat satisfaisant sur un seul cycle, ce résultat ne doit pas être utilisé pour soutenir une

réclamation selon laquelle le laboratoire a obtenu des données fiables en toute occasion.

Un laboratoire engagé dans un système qualité et enregistrant un historique des résultats satisfaisants

pendant plusieurs cycles d'un programme d'essais d'aptitude doit être en droit d'utiliser les résultats comme la

preuve qu'il est capable d'obtenir régulièrement des données fiables.

5 Détermination de la valeur assignée et de son incertitude type

5.1 Choix de la méthode de détermination de la valeur assignée

Cinq façons de déterminer la valeur assignée X sont décrites en 5.2 à 5.6. C'est au coordonnateur que doit

incomber la responsabilité de choisir entre ces méthodes, après avoir consulté des experts techniques

comme spécifié dans l'ISO/CEI Guide 43-1. Il est peu probable que les méthodes décrites en 5.5 et en 5.6

soient applicables lorsque les laboratoires participant au programme sont peu nombreux. Les méthodes de

calcul de l'incertitude type u de la valeur assignée, données dans le présent paragraphe, seront

X

généralement adaptées aux applications pour lesquelles elles sont utilisées dans la présente Norme

internationale. D'autres méthodes peuvent être utilisées dans la mesure où elles sont fondées sur une base

statistique éprouvée et où la méthode utilisée est décrite dans le plan documenté du programme.

La détermination de la valeur assignée relève de la responsabilité du coordonnateur. La valeur assignée ne

doit pas être dévoilée aux participants tant qu'ils n'ont pas fourni leurs résultats au coordonnateur. Le

coordonnateur doit préparer un document détaillant comment la valeur assignée a été obtenue, l'identité des

laboratoires intervenant dans la détermination de la valeur assignée et les déclarations de traçabilité et

d'incertitude de mesure de la valeur assignée.

Le Guide pour l'expression de l'incertitude de mesure fournit des lignes directrices sur l'évaluation des

incertitudes de mesure.

La présente Norme internationale recommande l'utilisation de méthodes statistiques robustes lorsque l'on

considère que ce sont les méthodes les plus appropriées (par exemple, comme en 5.5 et en 5.6). Sinon, des

procédures impliquant la détection et la suppression de valeurs aberrantes peuvent être utilisées dans la

mesure où elles sont fondées sur une base statistique éprouvée et où la méthode utilisée est indiquée.

L'ISO 5725-2 donne des recommandations sur l'utilisation de tests de recherche de valeurs aberrantes.

5.2 Formulation [voir l'ISO/CEI Guide 43-1:1997, A.1.1, alinéa a)]

5.2.1 Généralités

Le matériau d'essai peut être préparé en mélangeant les constituants dans des proportions spécifiées ou en

ajoutant une proportion spécifiée d'un constituant à un matériau de base. Dans ce cas, la valeur assignée X

est calculée à partir des masses utilisées.

Cette approche est particulièrement adaptée lorsque les échantillons individuels le permettent et qu'il faut

déterminer la proportion des constituants ou de l'additif. Il n'est alors pas nécessaire de préparer une quantité

en vrac et d'avoir à s'assurer de son homogénéité. Cependant, lorsque la formulation donne des échantillons

dans lesquels le mélange est moins homogène que dans les matériaux classiques ou dans une forme

différente, il peut être préférable d'utiliser une autre approche.

5.2.2 Incertitude type u de la valeur assignée

X

Lorsque la valeur assignée est calculée à partir de la formulation du matériau d'essai, l'incertitude type est

estimée par la combinaison des incertitudes selon l'approche décrite dans le Guide pour l'expression de

l'incertitude de mesure. Par exemple, en analyse chimique, les incertitudes seront généralement associées à

des mesurages gravimétriques et volumétriques.

Cette méthode (en analyse chimique) est limitée, car il faut prendre des précautions pour garantir:

a) que le matériau de base ne comporte effectivement aucune trace de l'additif ou que la proportion de

l'additif dans le matériau de base est connue précisément;

b) que les constituants sont mélangés de manière homogène (si cela est requis);

c) que toutes les sources d'erreur sont identifiées (par exemple, on ne réalise pas toujours que le verre

absorbe les composés du mercure, de sorte que la concentration d'une solution aqueuse d'un composé

du mercure peut être altérée par son contenant);

d) qu'il n'y a aucune interaction entre les constituants et la matrice.

5.2.3 Exemple: Détermination de la teneur en ciment du béton durci

Dans ce cas, les spécimens de béton peuvent être préparés en pesant des quantités de constituants (ciment,

granulats et eau) et en les mélangeant pour former chaque échantillon de béton. Cette approche est satis-

faisante, car l'exactitude avec laquelle les spécimens peuvent être préparés est bien supérieure à celle de la

méthode d'analyse utilisée pour déterminer la teneur en ciment.

5.3 Valeurs de référence certifiées [voir l'ISO/CEI Guide 43-1:1997, A.1.1, alinéa b)]

5.3.1 Généralités

Lorsque le matériau utilisé dans un essai d'aptitude est un matériau de référence certifié (MRC), sa valeur de

référence certifiée est utilisée comme étant la valeur assignée X.

5.3.2 Incertitude type u de la valeur assignée

X

Lorsqu'un matériau de référence certifié (MRC) est utilisé comme matériau d'essai, l'incertitude type de la

valeur assignée est déduite des informations sur l'incertitude figurant sur le certificat.

Cette approche a des limites dans la mesure où il peut être onéreux de fournir un échantillon d'un matériau de

référence certifié à chaque participant à un essai d'aptitude.

6 © ISO 2005 – Tous droits réservés

5.3.3 Exemple: Valeur Los Angeles de granulats

La «valeur Los Angeles» est une mesure de la résistance mécanique des granulats utilisés pour la

construction des routes. Les résultats de cette mesure sont exprimés en «unités LA». Dans un processus de